人間の体でも、どこかが調子悪いと他の部分にも悪い影響を与えたりするけども、それに近いものがPCでも起きるような気がする。

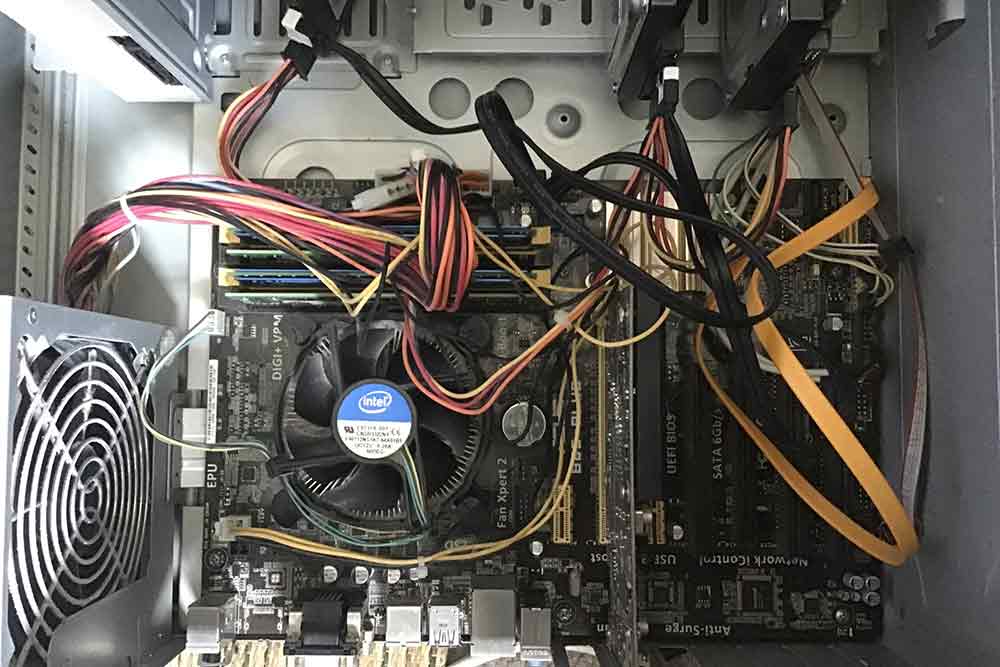

特に自分が使っている10年くらい前にアキバで新品5千円くらいで買ったASUSの『B85-PLUS』というマザーボードは、内蔵VGAがかなり前からぶっ壊れていてまともに映らないという症状があるのを認識していた。

ただ、どうせグラボを別途使っているから全く問題ではないからと無視していたのだけれど、ここ最近のHDDが突然認識しなくなったりする大きな不調を考えるに、全体的に老朽化が進んでいるからマザボだけでも早めに交換すべきだと判断した。

CPUとかも最新型に新調しようと思ったけれど

CPUも10年くらい前に発売されたCore i5 4570だから、第13世代あたりのものに買い替えようと思ったけれど、CPUとマザボとメモリも最低限セットで買い替えなければならないため、AMDのRyzen3を視野に入れつつ、エントリークラスで安物で組んだとしても3万前後はかかる。

CPUとメモリは普通に使っていたら10年くらいで経年劣化するようなシロモノじゃないし、丸ごと買い替えるのも何だかという感じ。

そもそも、i5 4570と第13世代coreやRyzen3のエントリークラスのスペックを比べたら、せいぜい120%~130%くらいの処理速度向上でしかない。ベンチマークソフト以外では誤差の範囲だし、カネを払ってまで載せ替えるレベルじゃないぞ、と。

10年、3650日間という長い時を感じさせるほどは、処理速度が向上しているようにも思わなかったのだ。

セキュリティとかAI周りとか、一般家庭では普通使わない何たらテクノロジーとかは新規開発されているんだろうけど、恩恵が感じられないのでは投資する意味がない。

元々、第4世代の完成度が高かったというのもあるが、第4世代以降は新技術の開発が数年単位で難航したり、モバイル向けに注力したりというのもあって、少なくともデスクトップ向けのCPUに関しては、化け物レベルの大幅進化は遂げていないのであった。

だったら、第4世代用のマザボだけ手に入るなら延命すればいいじゃん、というのが今回の本題である。

第4世代用のマザボは頑張れば新品でさえ手に入る

こんな10年も前の化石みたいなCPU向けのマザボなんて、エジプトの遺跡とか骨董品屋でも探さないと手に入らないのでは・・・と少し不安になったが、実際はネットで探せばあっと言う間に手に入る。

前任のB85-PLUSは安いというだけで買ったけれど、B85M-Gは少しだけ新しいマザボのようで、B85-PLUSと違ってHDMI端子があったりと少し今どき設計なのである。

驚くことに2020年頃までは店頭でも新品で売られていたようなマザボらしい。第4世代のマザボでだよ、第4世代の。

中古は個人売買系のものはもちろん、大手中古PCパーツ屋などでも割と余裕で手に入る。アキバの中古ショップとかでもあっと言う間に手に入るだろう。

さすがにプレミア価格が付いていたり、海外から取り寄せになったりするものもあるが、新品も手に入れようと思えば手に入るのが凄い。

第4世代が神がかっていて、今でもそこそこの需要があるという証拠だろう。

ちなみに、第4世代で最高スペックなのは下の型番のやつかな。

ゲームとかやる人にはいいと思うけど、日常作業ではi5 4570の方が省エネだし必要十分なスペック。

第4世代の資産(と言ってもマザボとメモリくらいだけど)を骨の髄までしゃぶりつくしたい人にもいいかもしれない。

Windows11はCPUチェックを回避させたりとチョメチョメとしないと起動できないが、そもそもWindows11を使う気がなければ何の問題もないし。

今どきはマザボを交換してもOSをそのまま起動できる

昔のイメージだとマザボとかCPUとかをPCそのものと言えるような部分を交換したら、Windowsのライセンスが無効になるような懸念があったけど、Windows10以降はMicrosofアカウントでログインしていれば、マザボを替えてもそのまま普通に使える。

逆に言うと、新調した高性能なPCパーツ一式にシステムが入ったSSDをぷっこめば、大体そのまま動くってことだと思うから何気に便利。PS1のゲームをPS2で起動するようなもんだよね。

ただしDTM系アプリなどの一部はライセンス認証が解除される

人によっては重要ポイントだから項目を設けた。

CPUやマザーボードなど普通の人が滅多に交換しないようなパーツが変更になった場合、DTMアプリやプラグインなどの一部は、それらのハードウェア情報に紐づけられてライセンス認証されているため再認証が必要になる。

有名どころだとCubaseのeLicenser周りとか、Wavesのプラグインとかが該当する。

ライセンス情報だけ紛失していなければ大抵は何とかなるが、マザーボードを交換する前に事前準備しておかないと死んでしまう場合があるので要注意だ。

ハードウェア情報を参照しているソフトは他にもあると思うので、それらのマニアックなソフトを使っている場合は注意しよう。DTM系は特にインストールやライセンス認証が無駄に複雑なのが大いから厄介。

久々にマザボを交換して躓いたことと気付きとか

普段からパーツいじりばかりやっているわけではないし、マザーボードやCPUを替えるレベルの大手術は5~10年に一度くらい。

電源LEDランプには2ピンと3ピンがある

マザーボードの配線で使う電源LEDランプは、10年以上前の古いPCケースだと3ピンで、ここ10年くらいのマザボでは2ピンが主流らしい。

B85-PLUSは3ピンだったけど、少し新しいB85M-Gは3ピンなので入らなかった。

最初、これが原因で電源そのもののピンも差すことができず、PCが起動できなくて詰んだかと思ったが、電源のLEDなんてどうでもいい(笑)ので使わないことで回避できた。

あのへんのちっこいピンの抜き差しは、針に糸を通すような細かい作業で久々に神経を使った。

プラスとマイナスの色分けは製品によってマチマチらしいので、差すまでわからないというのもポイント。間違って差しても壊れはしないが、やり直すのが面倒。自分のケースでは色付きがプラスっぽかった。

LGA1150のCPUカバーの装着方法が謎

意味のないことを考え続けるのは時間の無題なので考えないが、CPUのソケット部分を保護するカバーって、一度外すと俺には二度と装着することができない(笑)

何かコツがあるはずだけど、捨てる予定のマザボで装着しようとしたら、ミステリーサークルみたいにピンが何本もなぎ倒されたわ・・・。恐ろしい。

CPUを交換する作業は滅多にやらないけど、確実に心臓には良くないね。

未来編~自作PCとノートPCとの葛藤~

今どきは会社なんかでもオフィス内で全員ノートPCなのが基本だったりするけど、自宅のメインPCもノートPC化しようかという企みも以前はしていた。

消費電力はデスクトップの数分の1以下だろうし、実際のところ、デスクトップ用のi5 4570よりも第13世代のノートi7とかの方がずっとキビキビ速かったりするしね。コア数が全然違うから、当たり前っちゃ当たり前だけど。

ただ、会社だったら故障したらIT担当者にぶん投げれば無料で交換してくれるけど、自宅で個人所有のノートPCだと壊れたら自腹で修理依頼しないとならない。

自作PCみたいに壊れたパーツだけ中古で取り寄せて交換したりもできないし、大体においてノートPCの修理代金は目の玉が飛び出るくらい高いからノートPC化できないでいる。

サブではWindowsのノートPCやMacBookも使っているけども、修理代が半端じゃないから未だにメインにはできないでいる。